Deep Review:讓 AI Agent 學會「讀完文章再想想」

讀到好文章就想全盤照收?Deep Review 是一套給 AI Agent 的研究方法論,用六個階段把「我覺得不錯」變成「我分析過了,這是結論」。開源、免費、一個 prompt 搞定。

Deep Review:讓 AI Agent 學會「讀完文章再想想」

GitHub:p3nchan/deep-review

你有沒有過這種經驗:

讀到一篇超讚的技術文章,興沖沖地覺得「天啊我也要用!」然後三天後完全忘了,或者照搬了一堆東西進系統、過了一個月才發現根本用不到?

我有。而且不只一次。

問題出在哪

我們讀文章的時候,很容易被幾件事帶著走:

- 名氣——大神寫的就一定對嗎?

- 新鮮感——新的方法聽起來總是比較厲害

- 行動衝動——讀完總覺得「應該做點什麼」

問題從來不是文章寫得不好,而是我們跳過了分析。從「讀完」到「執行」之間,少了一步:好好想過。

但「好好想」需要時間和精力,人類通常沒有足夠的耐心把每個論點都攤開來檢視。

AI 有。

Deep Review 是什麼

Deep Review 是一套給 AI Agent 的研究方法論——一份結構化的 prompt,專門解決「該不該採用這篇文章的建議」這個問題。

它不是幫你摘要文章(那個隨便一個 AI 都能做),而是幫你分析:

- 這篇文章解決的問題,我真的有嗎?

- 它的建議有證據支撐嗎?還是只是觀點?

- 跟我現在的系統比,差在哪?

- 採用的成本和風險是什麼?

- 如果改了之後發現不行,退得回來嗎?

跑完之後,每條建議都會拿到一個明確的判定:採用、實驗、拒絕、或需要討論。

不靠直覺,靠流程。

六個階段

Phase 0:過濾

最重要的第一步——「我們有這個問題嗎?」

多數文章解決的問題你根本沒有。如果第一題的答案是「沒有」,整個分析直接結束。不浪費時間,不浪費 token。

「什麼都不改」是完全合理的結果。

Phase 1:提取

把文章拆成一條一條獨立的主張(claims),然後標記每一條的證據類型:

| 類型 | 例子 |

|---|---|

| 實驗數據 | 「我們測了 500 次,延遲降低 40%」 |

| 案例研究 | 「我們團隊用了之後生產力提高」 |

| 邏輯推理 | 「因為 A,所以 B 應該成立」 |

| 純粹觀點 | 「我覺得這樣比較好」 |

這一步純提取,不做判斷。先忠實呈現作者說了什麼。

還會問一個微妙的問題:如果這篇文章是匿名發表的,你還會覺得一樣有說服力嗎? 這是用來對抗權威偏誤——有時候我們被說服,不是因為論點好,是因為作者有名。

Phase 2:比對

把每條主張和你的系統現狀對照,而且必須引用具體的檔案和行數。

「我們系統裡好像有類似的東西」這種含糊的說法不被接受。要嘛指出 config.yaml:42,要嘛承認還沒查到。

Phase 3:論辯

針對每條主張,列出正反兩面:

- 支持:文章的證據 + 對我們的具體好處

- 反對:實施成本、和現有系統的衝突、作者沒考慮到的情境

- 缺失:做決定之前還缺什麼資訊

另外會從可靠性、可維護性、操作性、複雜度四個面向評估影響,以及一個常被忽略的問題:如果採用之後後悔了,退回來的成本高嗎?

Phase 4:決策

每條主張一張決策卡,格式統一:

- Claim:這條主張是什麼

- Decision:採用 / 實驗 / 拒絕 / 需要討論

- Reasons:前 2-3 條理由

- Concrete change:如果要改,改哪個檔案的哪個部分

- Expected consequences:預期的正面和負面影響

不是只有「好」跟「不好」——有時候答案是「先小規模試試」,有時候是「東西不錯但我們不需要」。

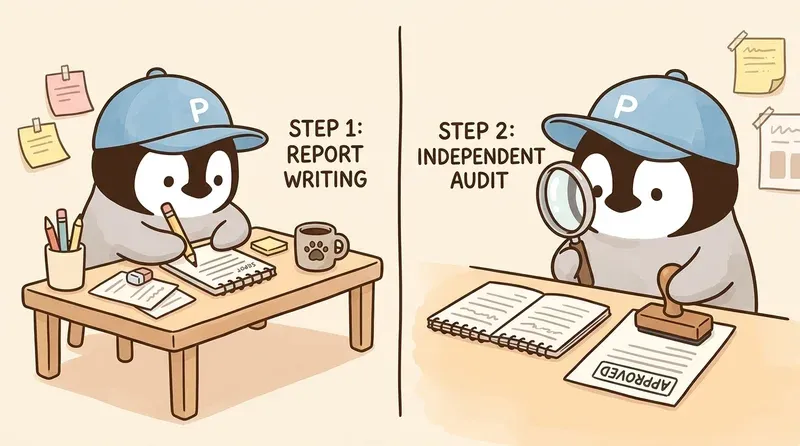

Phase 5:審計

最後一步,也是最關鍵的設計:審計必須由獨立的 subagent 執行。

為什麼?因為 AI 在同一次對話中檢查自己的輸出,幾乎一定會說「看起來沒問題」。研究顯示這種自我審查的辨別力趨近於零。

獨立 subagent 會檢查幾個常見的失敗模式:

- 所有主張都被採用,或全部被拒絕(沒有分辨能力)

- 比對表裡沒有具體的檔案路徑(含糊帶過)

- 反對意見全都是「需要更多資料」(迴避判斷)

- 支持論點只是重述文章(沒有結合自身情境)

還會問一個狠問題:如果跳過整個分析、30 秒靠直覺做決定,結論會一樣嗎? 如果答案是「會」,代表這個分析沒有產生額外價值。

這不是審查來源,是學習方法

有人可能會問:這算是在「審核」文章嗎?

不是。Deep Review 的核心態度是學習,不是複製,也不是批判。

我們不是要判定一篇文章「對」還是「錯」——而是在問:「這篇文章裡有什麼東西,對我的系統有用?」

Phase 5 的審計,審的也不是文章本身,而是分析過程的品質。帶著學習的心態去評估資源,輕量的紅旗檢查就夠了。

怎麼開始用

最簡單的方式:

- 把

deep-review.md放到你的專案目錄或~/.claude/裡 - 在 Claude Code 裡輸入

deep-review,貼上文章 - 等它跑完六個階段,拿到結論

就這樣。一個檔案,不用裝任何東西。

如果你不是用 Claude Code,也沒關係——deep-review.md 就是一份結構化 prompt,可以拿去 Cursor、Windsurf 或任何能讀 markdown 的 AI 工具裡用。

為什麼做這個

我在建構自己的 AI Agent 系統時,每天都會讀到大量的技術文章和別人的做法。有些真的很好,有些聽起來很好但其實不適合我。

問題是:我沒有時間和精力把每篇都仔細分析。直覺判斷又常常出錯——不是過度樂觀就是完全忽略。

所以我做了 Deep Review:讓 AI 幫我把「直覺」變成「流程」。

不是所有文章都需要跑這套分析——簡單的小技巧看看就好。但遇到那些可能改變你系統架構或工作流程的文章時,花幾分鐘跑一下 Deep Review,可以省下之後幾小時的踩坑時間。

背後的研究

這不是拍腦袋想出來的。設計有據可查:

- CheckEval — 為什麼 checklist 比開放式評分更好

- LLM-as-Judge 研究 — AI 當評審時的已知偏見

- 多 Agent 辯論研究 — 為什麼 AI「角色扮演辯論」常常適得其反

- Heilmeier Catechism — DARPA 的提案評估方法

- Architecture Decision Records — 工程團隊記錄決策的標準格式

Deep Review 是開源的,MIT 授權。如果你覺得有用,歡迎拿去改、拿去用。

GitHub:p3nchan/deep-review